Anthropic CEO Dario Amodei:海啸已在地平线上,但没人在看

TL;DR

Anthropic CEO Dario Amodei 在访谈中警告 AI 海啸已近,但社会认知滞后。他分享从生物学转向 AI 的历程,强调安全与权力集中的担忧,并讨论 AI 对工作、创业机会的影响。

Key Takeaways

- •Dario Amodei 认为 AI 技术进展迅速,但社会对即将到来的颠覆性影响缺乏足够认知,比喻为'海啸已在地平线上'。

- •他离开 OpenAI 创办 Anthropic 源于安全理念分歧,强调通过具体行动(如延迟发布 Claude、支持监管)践行 AI 安全承诺。

- •AI 可能替代写代码等任务,但批判性思维、人际关系和物理世界相关技能仍具价值;创业者应建立行业壁垒而非简单套壳。

- •Anthropic 在印度聚焦与企业合作而非消费者市场,收入在短期内翻倍,看好 AI 驱动生物科技如肽类药物的发展。

- •权力集中问题需通过治理机制(如 LTBT)和监管制衡,AI 意识等未知问题需谨慎探索。

Dario Amodei,Anthropic 的 CEO、Claude 背后的人,本科物理、博士生物物理,原本想做教授去治病。从 OpenAI 出走创业四年多,公司估值已达 3800 亿美元,年化收入 140 亿美元。

2026 年 2 月,他第二次来到印度班加罗尔,坐在 Zerodha 联合创始人 Nikhil Kamath 对面,聊了一个多小时。Nikhil 不是技术背景出身,他的问题带着投资人的怀疑和创业者的焦虑,多次直接挑战 Dario 的安全叙事。话题从 scaling laws 的化学反应比喻到 AI 意识的“辞职按钮”,从“有钱人说资本主义不好”的尖锐追问到“年轻人该学什么”的实用建议。

Dario 一边说“AI 海啸已经到了地平线上”,一边承认“我对权力集中感到不安”;Nikhil 一边展示自己用 Claude Code 写金融程序的经历,一边追问“你不会拿走我平台上创业者的收入吗”。

原始视频:https://www.youtube.com/watch?v=68ylaeBbdsg 节目:People by WTF,2026 年 2 月 24 日

要点速览

- Dario 早在 2019 年 GPT-2 阶段就看到了 scaling laws 的迹象,成功说服 OpenAI 领导层重视,但在安全理念上未能达成共识,最终离开创办 Anthropic

- 2022 年 ChatGPT 发布前,Anthropic 已有 Claude 的早期版本但选择不发布,为避免引发军备竞赛,代价是“可能让出了消费者 AI 的领先地位”

- 技术层面的安全工作比预期好,社会层面的认知比预期差,两者“大致抵消”

- Anthropic 一位联合创始人把个人日记喂给 Claude,Claude 准确预测了他“还没写下来的恐惧”

- 写代码会率先被 AI 替代,然后是更广泛的软件工程。长期来看,AI 可能在“基本上一切”上超过人类

- 创业者不要做“Claude 的套壳”,要建立行业壁垒;Anthropic 的印度收入在 3.5 个月内翻倍

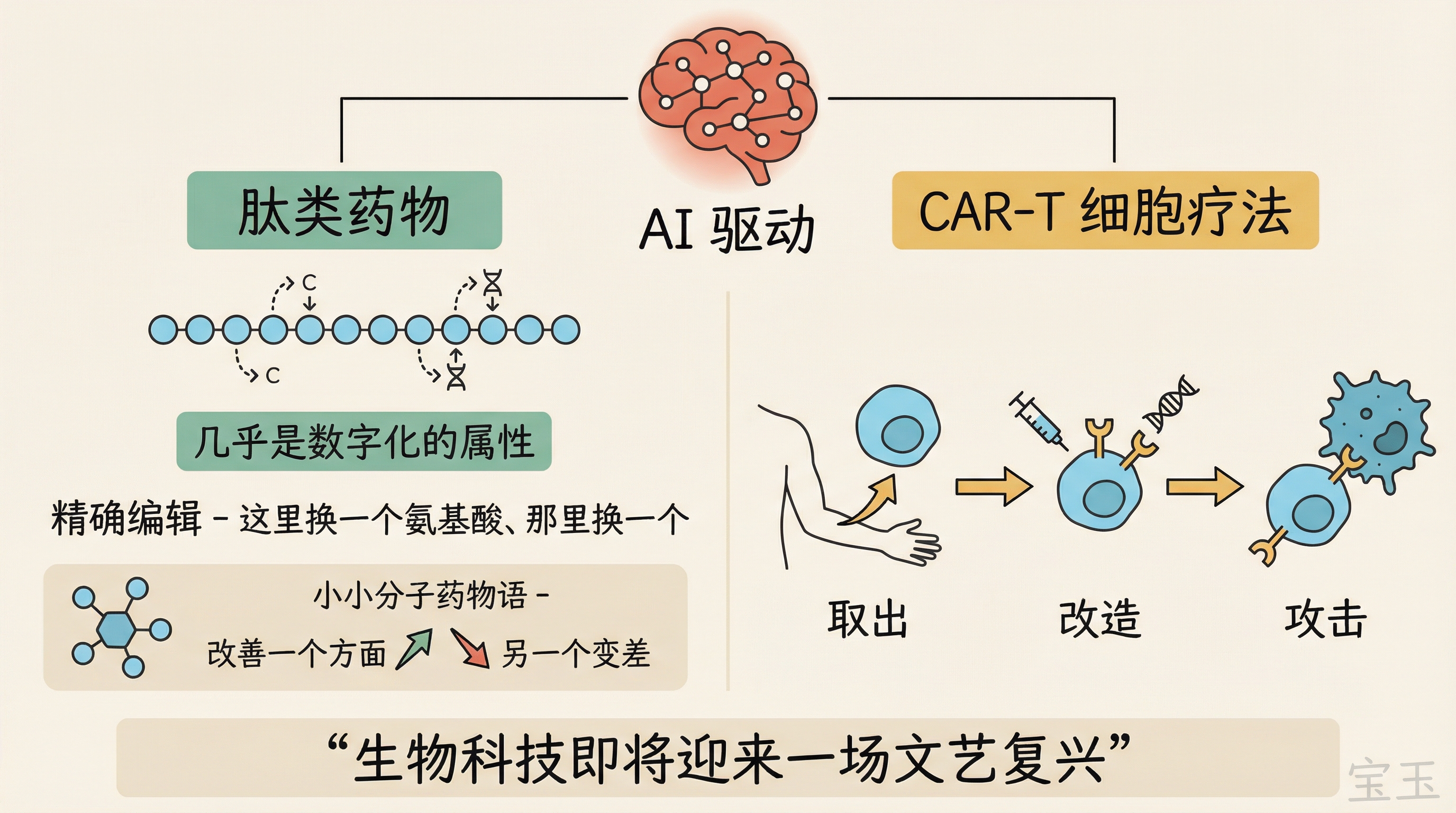

- Dario 看好肽类药物和 CAR-T 细胞疗法,认为 AI 驱动的生物科技“即将迎来文艺复兴”

从生物学家到 AI:一条被“绝望”驱动的路

Nikhil 的第一个问题:创办 Anthropic 之前你在做什么?

Dario 的起点不是计算机科学,而是生物学。本科学物理,博士读生物物理,做过蛋白质组学的研究,目标是理解生物系统然后去治病。但研究做着做着,他开始“绝望”了。

一个蛋白质,RNA 会根据在细胞中的位置以不同方式剪接,然后被磷酸化,跟一堆其他蛋白质形成复合物。他开始怀疑这种复杂度可能超出了人类理解的极限。

就在那时候,他注意到了 AlexNet。

注:AlexNet 是 2012 年 ImageNet 图像识别竞赛中取得突破性成绩的深度学习模型,被广泛认为开启了深度学习的现代纪元。

“AI 实际上开始起作用了,它跟人脑的工作方式有一些共同点,但有潜力变得更大、扩展得更好。”他意识到,AI 或许才是最终解决生物学问题的工具。

于是他离开学术界,先后在百度(Andrew Ng 的团队)和 Google 工作了一段时间,然后在 OpenAI 成立几个月后加入,领导了整个研究部门好几年。最终,他和几位同事带着自己的愿景离开,创办了 Anthropic。

他差点走上另一条路。原本打算当教授,在斯坦福医学院做博士后时仍在瞄准学术界。但 AI 研究需要大量算力,这些资源主要集中在工业界。"但我想我内心深处可能还是个教授。"

离开 OpenAI:技术上说服了,理念上没说服

Nikhil 追问:离开 OpenAI 是因为理念分歧吗?

Dario 说有两个核心信念驱动了他们创办 Anthropic。

第一个是 scaling laws(规模定律)的信念。 他在 2019 年研究 GPT-2 时最先看到了这个趋势,花了不少力气说服 OpenAI 的领导层重视。这一点他们最终成功了。

第二个信念就没那么顺利了: 如果这些模型将成为通用的认知工具,匹配人脑的能力,那经济影响、地缘政治影响、安全影响都将是巨大的。“我们必须以正确的方式来做这件事。”

他没有指名道姓,但措辞不难理解。“尽管有很多关于正确做事的措辞和语言,但我出于各种原因,就是没有被说服那个机构真的在认真地、严肃地以正确方式做这件事。”

最终他选择离开,而不是留下来争论。

不要去跟别人的愿景争论。如果你有一个强烈的愿景,而且你和几个人分享这个愿景,你就应该自己去做。这样你要为自己的错误负责,不需要替别人的错误买单。 (“Don't argue with someone else's vision... if you have a strong vision and you share that vision with a few other people, you should just go off and do your own thing.”)

注:Dario 提到的 GPT-2 发布于 2019 年,当时 OpenAI 最初因担心滥用而选择延迟发布完整模型,但其语言生成能力已经引起业界关注。

Nikhil 反问:OpenAI 不也走了 scaling 这条路吗?Dario 的回答只有三个字:“Yeah, we succeeded.” 正因为他成功说服了 OpenAI,两家公司后来都走了同一条路。

Scaling Laws:“智能是化学反应的产物”

Nikhil 请 Dario 用最简单的方式解释 scaling laws。

Dario 用了一个化学反应的比喻:如果你想让一个化学反应产生氧气或者生火,需要不同的原料,少了任何一种反应就停了。AI 的“原料”是数据、算力和模型规模。按比例投入这些原料,产出的就是智能。

智能是化学反应的产物。 (“Intelligence is the product of a chemical reaction.”)

跟五年前有什么区别?Dario 直接举了一串例子。5 年前你不能问电脑一个问题然后让它写一页论文。不能让它在代码里实现一个功能。不能生成图像。不能生成视频。

他强调了一个关键区别:这不只是在互联网上匹配已有的文本。"你可以给它一个假设,比如'如果让猴子抛的不是球而是棒呢',这种信息不存在于任何地方,但模型能自己思考,给出一个答案。"

权力集中:“一夜之间、几乎偶然发生的”

Nikhil 直接问:如果 AI 是世界上最重要的事,而你坐在这个领域的顶端,一个原本要当教授的人,准备好了吗?

Dario 先试图分散焦点,指出产业链上有很多层,芯片制造商、半导体设备商、模型公司、应用开发者、政府、公民社会。“我的希望不是只有一小群人是重要的。”

但他承认:

我公开说过,我对 AI 领域正在发生的权力集中感到不安。这种集中几乎是一夜之间、意外发生的。 (“I'm at least somewhat uncomfortable with the amount of concentration of power that's happening here, almost overnight, almost by accident.”)

他给出了两个制衡方案。一个是 Anthropic 特有的 LTBT(Long-Term Benefit Trust,长期利益信托),一个由与公司没有经济利益关系的人组成的独立机构,最终将有权任命 Anthropic 多数董事会成员。另一个是政府监管,他一直在推动“明智的、不减缓技术发展的”AI 监管。

注:LTBT 目前由 5 名受托人组成,背景涵盖 AI 安全、国家安全和公共政策。其权力正在分阶段”激活”,到 2024 年底已可选任 5 名董事中的 3 名。不过,外部分析者曾质疑 LTBT 的实际约束力,认为股东可能有权修改或推翻 Trust 的条款。

安全承诺:“不是看你说了什么,而是看你做了什么”

Nikhil 说:作为一个旁观者,他在达沃斯听过 Dario 和 Demis Hassabis 等人谈 AI 需要谨慎推进。但社交媒体上的反应是:几个有钱人坐在一起说要为更大的利益行动,谁信?他建议:与其展示谦虚,不如直接承认你有股东、追求利润,这反而可能更有效。

Dario 列举了他们做过的一些具体事情。

第一个例子: 2022 年他们做出了 Claude 1,在 ChatGPT 之前。但选择不发布,担心引发军备竞赛。“这在商业上代价很大,我们可能因此在消费者 AI 上让出了领先地位。”

注:多个来源证实了这个时间线。Anthropic 在 2022 年夏天完成了第一版 Claude 的训练,但直到 2023 年 3 月才对外发布。ChatGPT 于 2022 年 11 月上线。

第二个例子: Anthropic 是唯一一家主动支持加州 SB 53 法案的大型 AI 公司,在所有其他公司和美国政府都说不应该有 AI 监管的时候。

注:SB 53(《前沿人工智能透明度法案》)于 2025 年 9 月 29 日由加州州长签署成法,是美国第一部专门针对前沿 AI 模型的监管法律。它要求年收入超过 5 亿美元的 AI 开发者公开安全框架、报告安全事件,并提供吹哨人保护。实际只适用于约 5-8 家公司。

第三个例子: 在芯片政策上的主张“让一些作为供应商的芯片公司非常生气”。

Dario 强调 SB 53 豁免了所有年收入低于 5 亿美元的公司,实际只约束 Anthropic 和另外三四家公司。“说我们在搞监管捕获的人,需要看看我们实际提出的内容。”

“有钱人说资本主义不好”

Nikhil 不买账。他换了个角度:这不就是有钱人说资本主义不好吗?有钱人如果真觉得资本主义有问题,最简单的做法是停止积累更多财富。

Dario 接住了这个类比,但重新定义了它。他说自己不是在说“AI 不好”,而是在说 AI 需要引导:

我们正在把这辆车开向一个好地方,但路上有树、有坑洞。我们需要绕开它们,偶尔可能需要减速。 (“We're steering this car towards a good place but also there are trees, there are potholes... we might need to occasionally slow down a bit.”)

更准确的类比不是“有钱人说资本主义不好”,而是“有钱人说资本主义总体是好的,但它需要调节,需要处理污染和不平等之类的问题”。

两篇长文:海啸已在地平线上

Nikhil 读过 Dario 的两篇长文,2024 年 10 月的《Machines of Loving Grace》和 2026 年 1 月的《The Adolescence of Technology》,认为这反映了 Dario 从乐观到悲观的 180 度转变。

Dario 否认了。"光明面和阴暗面一直同时存在于我脑中。“两篇文章各花了约一年从模糊构思到最终写成,而且都是在假期、远离公司日常事务时才完成的。写完乐观篇后,他”几乎立刻“就开始构思悲观篇。”我想用好愿景激励人们,但也想用坏愿景警告人们。"

注:《Machines of Loving Grace》阐述了 AI 可能在生物学、神经科学、经济发展等领域带来的巨大进步。《The Adolescence of Technology》则聚焦五类 AI 风险:自主行为失控、大规模杀伤性武器扩散、权力夺取、经济颠覆,以及未知风险。Dario 在后者中预测“50% 的初级白领工作可能在 1-5 年内被 AI 颠覆”。

Nikhil 追问:你的看法真的没变吗?

Dario 拆成了两个维度。

技术乐观方面: 可解释性(interpretability)研究的进展超出了他的预期。“我们找到了对应非常具体概念的神经元,找到了追踪诗歌韵律的神经回路。”对齐研究和 Claude 的“宪法”机制也让他感到积极。

注:可解释性是 AI 安全研究的一个方向,目标是理解神经网络内部的工作机制。Anthropic 在 2024 年发表了突破性论文,展示了从 Claude 中提取出数百万个可理解的“特征”,对应具体概念如“金门大桥”。

社会悲观方面:

在我看来,这些模型离达到人类智能水平已经非常近了,但社会似乎没有更广泛地意识到即将发生什么。就好像海啸正朝我们涌来,我们离得很近,已经能在地平线上看到它了,但人们还在编造各种解释说“啊那不是真的海啸,那只是光线的错觉”。 (“It's as if this tsunami is coming at us and it's so close we can see it on the horizon and yet people are coming up with these explanations for oh it's not actually a tsunami, that's just a trick of the light.”)

他总结说:技术安全工作比预期好一点,社会认知比预期差一点,"大致抵消",所以他的整体感受跟几年前差不多。

AI 越来越了解你:天使还是恶魔?

Nikhil 分享了自己使用 Claude 的经历。他不是程序员出身,但最近雇了个开发者教他用 Claude Code 写金融服务相关的程序。他把 Google Drive、邮箱、日历都用连接器接上了 Claude,还在一台 Mac Mini 上搭了环境,连了一个 Telegram 账号跟它聊天、远程操作服务器。

“有时候它对我的了解程度会让我吃惊。”

Dario 讲了一个他的联合创始人的故事。这位联合创始人写了一本个人日记,记录了自己的想法和恐惧,然后把它喂给了 Claude。Claude 说:"这是你可能有但还没写下来的一些恐惧。“结果 Claude 说的大部分都是对的。”这真的给人一种诡异的感觉,就好像模型了解你、超级了解你。"

一个超级了解你的东西,可以是你肩上的天使,帮助你成为更好的自己。但它也可以利用对你的了解来操纵你、替某个议程服务、或者把你的数据卖给别人。

如果你不是在为产品付费,你本身就是产品。 (“You're not paying for the product, like you're the product.”)

“在广告模式下,一个深度了解用户的 AI 就会变成用各种不正当方式利用这种信息的工具。这是我们不喜欢广告的原因之一。”

注:2026 年 2 月超级碗期间,Anthropic 播放了一系列广告,每个广告都展示 AI 助手在对话中途突然开始推广虚构产品。Anthropic 借此宣布 Claude 将保持无广告,以此与竞争对手区分。

Nikhil 追问:Claude 需要通过连接器才能获取用户生活的上下文,而 Google 天然就有这些上下文。Anthropic 长远来看是不是也得自建邮箱、聊天等整个生态系统?

Dario 说不一定。“我们会混合自建和集成。我们可以把 Claude 集成到 Google Docs、Google Sheets、Microsoft Office 里。”但他没有排除未来的可能性:“也许传统的邮箱或电子表格在 AI 时代不再合理,我们可能会用不同的方式来切分产品。”

AI 意识:“我辞职”按钮

Nikhil 问:AI 会有意识吗?

Dario 说这是“我们真的没有答案的神秘问题之一”。他的猜测是,意识是"足够复杂的、能反思自身决策的系统的涌现属性“。作为一个研究过大脑的人,他认为 AI 模型跟大脑”在某些方面不同,但在根本层面上没有本质区别"。

他认为当 AI 系统足够先进时,它们将拥有“某种我们会称之为意识或道德重要性的东西”,但可能不同于人类意识。

Anthropic 已经给模型提供了一种“退出对话”的能力,Dario 把它比作“我辞职”按钮。模型在遇到“特别暴力或残忍的内容”时会使用这个功能终止对话,不过通常只在非常极端的情况下发生。

Nikhil 坦言自己觉得世界很随机,人类“跟蟑螂没差多远”,踩死一只蟑螂它就死了,如果有什么集体意识之类的东西,他没能感受到。Dario 回应说意识不一定需要神秘主义的解释,可能就是一种“意识到自己存在、能感受事物、能注意到自己正在注意某件事”的属性。

印度:“我们不是来找消费者的”

Nikhil 生长在班加罗尔,亲眼见证了 IT 服务行业如何塑造了这座城市。他问:AI 时代印度的角色是什么?

Dario 说这是他第二次来印度(上一次是 2025 年 10 月),他见了印度主要的 IT 和综合企业集团(“你能想到的那些”,他没有点名),现在已经在跟大部分合作了。

他强调 Anthropic 的定位跟其他 AI 公司不同:

很多公司来这里把自己当消费公司,把印度当市场、当获取消费者的地方。我们看法不同——我们想跟印度的公司合作,把工具提供给它们,帮它们更好地做自己的事。 (“Many other companies come here as themselves a consumer company and they see India as a market... We actually see things a little bit differently.”)

印度公司比 Anthropic 更了解印度市场,无论是做咨询、系统集成还是 IT 工具,它们在本地市场都做得更好。Anthropic 的角色是把 AI 加到它们已有的能力上,增强而非替代。

具体数据:自 2025 年 10 月他上次访问以来,Anthropic 在印度的用户数和收入翻了一番,"也就是大概三个半月的时间"。

注:Anthropic 于 2026 年 2 月正式在班加罗尔开设办公室,这是其在亚太地区的第二个办公室(第一个在东京)。Anthropic 表示印度是 Claude 使用量的全球第二大市场,近一半的印度 Claude 使用量用于编程和技术任务。同期,Dario 出席了在新德里举行的 AI Impact Summit 2026,并与印度总理莫迪会面。

工作会被取代吗:阿姆达尔定律与放射科医生

Nikhil 用蒸汽机的故事来提问。蒸汽机发明之初需要人来操作,但随着技术迭代,操作者变得越来越不重要。如果 Anthropic 今天跟印度 IT 服务公司合作,10 年后这些公司会不会变成蒸汽机旁边那个多余的人?

Dario 承认自动化的范围会持续扩大,“这对所有人来说都是个问题,不只是 IT 公司”。但他认为有几个缓冲因素。

第一,物理世界。 AI 目前主要在数字世界工作,机器人技术会来但那是另一个维度的事。

第二,人际关系。 很多 IT 公司同时也是咨询公司,有庞大的关系网络。在机构中推动事情落地、理解机构运作方式,这些能力短期内仍然有价值。

第三,他引用了阿姆达尔定律(Amdahl's Law,系统整体提升受限于最慢的环节)来解释:一个流程有多个环节,当你加速其中一些环节后,没被加速的那些反而变成瓶颈,变成最重要的东西。“你之前可能根本没把它们当回事,没把它们当护城河或重要组件,但当写软件变得容易得多之后,公司原有的一些优势会消失,但另一些从没被重视的优势会突然变得超级重要。”

他还举了放射科医生的例子。Geoffrey Hinton 曾预测 AI 会取代放射科医生,AI 确实在读扫描片上超过了放射科医生。但放射科医生并没有减少,他们转向了跟病人沟通、陪病人走完检查流程这些工作。“这份工作中技术含量最高的部分消失了,但某种对底层人际技能的需求仍然存在。”

Nikhil 说:"我不完全买账。“如果一个 AI Agent 能帮他管理人际关系和对话,那所谓的”关系网络"护城河也撑不了多久。

Dario 承认:"长远来看,AI 会不会在基本上一切事情上都比我们强?包括物理世界、机器人、人际接触?我觉得这是可能的,甚至很可能的。"

但他说我们需要”一步步来”,用实证科学的方式观察 AI 实际做了什么,然后适应。”让我们先看看 AI 今天能做什么,去适应它,然后再看接下来会发生什么。”

创业者的机会:可能性球体每 2-3 个月扩大一次

Nikhil 替他的印度创业者观众问:AI 领域具体有什么机会?

Dario 说应用层有大量机会。Anthropic 每 2-3 个月发布新模型,每次都意味着一批之前不可能实现的事情变得可能了。”有人说 API 模型不可行或者会被商品化,但他们没看到的是,AI 能做什么的范围在不断扩大。”这不是一个静态市场,而是一个不断膨胀的可能性球体。

Nikhil 追问:Anthropic 估值 3800 亿美元,融了 350 亿美元,收入 150 亿美元还在快速增长。如果一个印度班加罗尔的创业者在 Claude 上面建了一个应用碰巧成功了,Anthropic 不会来拿走这个收入吗?他用法律 AI 公司 Harvey 的例子,Harvey 建在 OpenAI 上面,但不知道 OpenAI 什么时候会自己做这个功能。

Dario 先给了通用建议:"要建立护城河,不要只做套壳产品。"只是给 Claude 套个 UI 或者写个提示词模板是没有护城河的,你不需要担心 Anthropic 来吃这个收入,任何人都能吃。

然后他给出了有护城河的方向:生物×AI(“我碰巧是生物学家,但 Anthropic 的大多数人不是”)、金融服务(“有大量监管,需要懂很多东西才能合规”)。这些领域对 Anthropic 来说“效率太低”,不会去做。

但他也承认有些领域 Anthropic 会直接竞争:"我们不会承诺永远不做第一方产品。比如 Claude Code,Anthropic 的人写代码,所以我们对如何用 AI 写代码有特殊的洞察。在代码领域我们确实成了非常强的竞争者,因为这是我们自己在用的东西。但我不认为这能推广到所有行业。"

注:根据 Anthropic 公开数据,截至 2026 年 2 月,其年化收入达到 140 亿美元,其中约 80% 来自企业客户。Claude Code 的年化收入达到 25 亿美元。

年轻人该学什么:批判性思维是最后的边缘

Nikhil 问:一个 25 岁的印度年轻人,想在未来十年里在资本主义竞争中赢,该选什么方向?

Dario 给了三个方向。

第一,以人为中心的工作。 涉及与人打交道的职业有更长的跑道。

第二,物理世界相关的工作。 半导体是一个好例子,有“物理世界”和“传统工程”两个 AI 还没完全覆盖的维度。

第三,也是他最强调的:批判性思维。 当 AI 能生成任何内容,图像、视频、文本,分辨真假变得越来越难。“成功的很大一部分可能就是拥有街头智慧,不被虚假内容骗到。你不想持有错误信念,不想被诈骗。”

他补充说 Anthropic 不做图像和视频生成,“有很多原因,这是其中之一”。

关于写代码和软件工程,他做了一个区分:写代码(写代码的具体动作)会先被 AI 替代,但更广泛的软件工程(系统设计、理解用户需求、管理 AI 团队)需要更长时间。即便如此,他认为这也终将发生。

但他补充了一个反直觉的观点:即使你只做任务的 5%,因为 AI 做了另外 95%,你的产出被放大了 20 倍。"比较优势出奇地强大。"

去技能化:“如果部署不当,人类会变笨”

Nikhil 问:历史上每次创新都杀死了一种核心人类技能。计算器杀死了心算能力,书写减弱了人类的记忆力。AI 杀死的是什么?

Dario 先挑战了前提:“我不完全同意。我仍然经常在脑中做数学计算,因为它跟我的思维过程更融合。比如我想算'如果每个用户付这个金额,收入是多少',我想在脑子里闭合这个循环,而不是交给计算器。”

但他承认如果使用方式不对,技能退化确实会发生。“我们已经开始看到了,学生让 AI 写论文,这基本就是作弊。”

Anthropic 做了关于代码的内部研究。结果取决于使用方式,"有些使用方式不会导致去技能化,有些会"。

Nikhil 追问:你觉得人类作为一个种族会不会在未来十年变得更笨?

Dario 说:"如果我们以错误的方式部署 AI、漫不经心地部署,那是的,人们可能会变笨。即使 AI 在某件事上永远比你强,你仍然可以学习那件事,仍然可以在智识上充实自己。所以这是我们作为公司、个人和社会整体必须做出的选择。"

开源 vs 闭源:“唯一重要的是最好的模型”

Nikhil 问:开源模型越来越好(他提到了智谱的 GLM5 和 DeepSeek),建应用是不是该选开源?

Dario 的回应分为两层。

第一层: 他认为很多这些模型,特别是来自中国的,“针对基准测试做了优化,是从美国大型实验室蒸馏出来的”。他提到最近有人做了一个未公开的测试,这些模型在常规基准上得分很高,但在这个之前从未被公开测量过的新测试上“表现差了很多”。

注:Dario 没有给出具体的测试名称或来源。作为闭源模型公司的 CEO,这一判断存在明显的利益相关性。

第二层是更宏观的经济学论点。 AI 模型的市场跟以往任何技术都不一样,它更像人才市场。“如果我跟你说,你可以雇世界上最好的程序员或者第 10000 名程序员,他们都很有技能,但任何雇过大量人的人都有这种直觉,能力有一种幂律长尾分布。模型也一样。”

在这种分布下,价格不太重要,呈现形式不太重要,只有认知能力最重要。"我几乎完全只关注一件事:拥有最聪明的模型。我认为这是长期唯一重要的东西。"

数据主权与生物科技

谈到数据的地缘政治问题时,Dario 做了一个区分。训练数据正在从静态数据转向动态数据,当模型在数学问题或写代码环境上做强化学习时,“你不是在获取传统意义上的数据,更像是模型自己在做试错”。所以静态数据的重要性在下降。

但客户数据和个人数据的本地化需求是真实的。欧洲已经立法要求个人和专有数据留在各国境内,这是各国建设本地数据中心的一个重要原因。

话题转到投资时,Nikhil 试图让 Dario 推荐一只股票。“我把同样的问题逼着 Elon 回答了,他说 Google。”

Dario 果断拒绝了个股推荐(“我了解太多上市公司的内部信息”),但在被追问具体行业后松了口。

他看好生物科技。“生物科技即将迎来一场文艺复兴,最终将由 AI 驱动。我们即将治愈很多疾病。”

他特别看好两个方向:

- 肽类药物(peptide-based therapies):小分子药物的自由度有限,“改善一个方面另一个方面就变差”,而肽类有一种“几乎是数字化的属性”,可以说“我在这里换一个氨基酸、在那里换一个”,允许更精确的连续优化

- CAR-T 等细胞疗法:从患者体内取出细胞,进行基因工程改造使其攻击特定癌症,然后放回体内

Nikhil 问干细胞疗法管不管用,他上周刚花了一整周在医院做雾化吸入和静脉注射干细胞。Dario 笑着说他不了解干细胞疗法的最新进展,”你得问一个现在还在执业的生物学家”,但重申了对肽类疗法的信心。

学会使用 AI:“钢琴不是坐下来就能弹的”

Nikhil 坦言自己第一次用 Claude Code 时遇到了困难。“对于一个很笨、没有编程知识的人来说,它不是非常容易上手的。就像弹钢琴一样,你不能坐下来就弹。”

Dario 同意存在学习曲线,并透露 Cowork 的诞生正是因为看到很多非技术用户在命令行终端里苦苦挣扎。“对程序员来说命令行终端很日常,但对非程序员来说它让事情变得不必要地复杂。”Cowork 在底层由 Claude Code 引擎驱动,但设计成了更友好的界面。

他还提到 Anthropic 内部有一个叫“教育部”(Ministry of Education) 的部门,正在制作更多关于如何有效使用 Agent 和提示词模型的教学视频。“我们会加大力度,因为我们确实希望每个人都能学会这个。”

“几乎可以免费预测未来”

Nikhil 最后问:你知道什么是其他人不知道的?

Dario 说他知道的大多数事情现在其实已经是公开信息了。但他有一个过去十年反复验证的经验:

人们总有一种诱惑去相信“那不可能发生,变化太大了,太疯狂了”。但一次又一次,简单地外推曲线,或者从第一性原理推理,就会得到几乎没人相信的反直觉结论。你几乎可以免费预测未来,只需说“从逻辑上推断……” (“You can predict the future for free just by saying 'well it stands to reason that...'”)

他补充说,纯逻辑推理是另一种错误。你需要的是"少量经验观察“加”第一性原理思考"的正确组合。这种能力是公开的,任何人都应该能做到,但做到的人少得惊人。

Dario 在这场对话里很直接。他承认权力集中让他不安,承认 Anthropic 会在擅长的领域跟创业者直接竞争,承认 AI 最终“可能在基本上一切事情上都比人类强”。

但直接不等于答案。Nikhil 问出的那些最尖锐的问题,“你的谦逊是策略吗”、“这不是有钱人批评资本主义吗”、“你不会拿走创业者的收入吗”,得到的回答都指向“看我们的行动”。而行动的解读空间很大。

几个值得持续观察的信号:

- Anthropic 的 LTBT 治理机制在面临真正的压力测试时能否发挥作用

- SB 53 法案实施后的行业影响

- AI 从“替代写代码”到“替代软件工程”的实际时间线

- 以及 Dario 预言的“AI 海啸”到来时,社会是否已经做好了准备,或者仍在说“那只是光线的错觉”